Die Ära der Agentic Search Engines

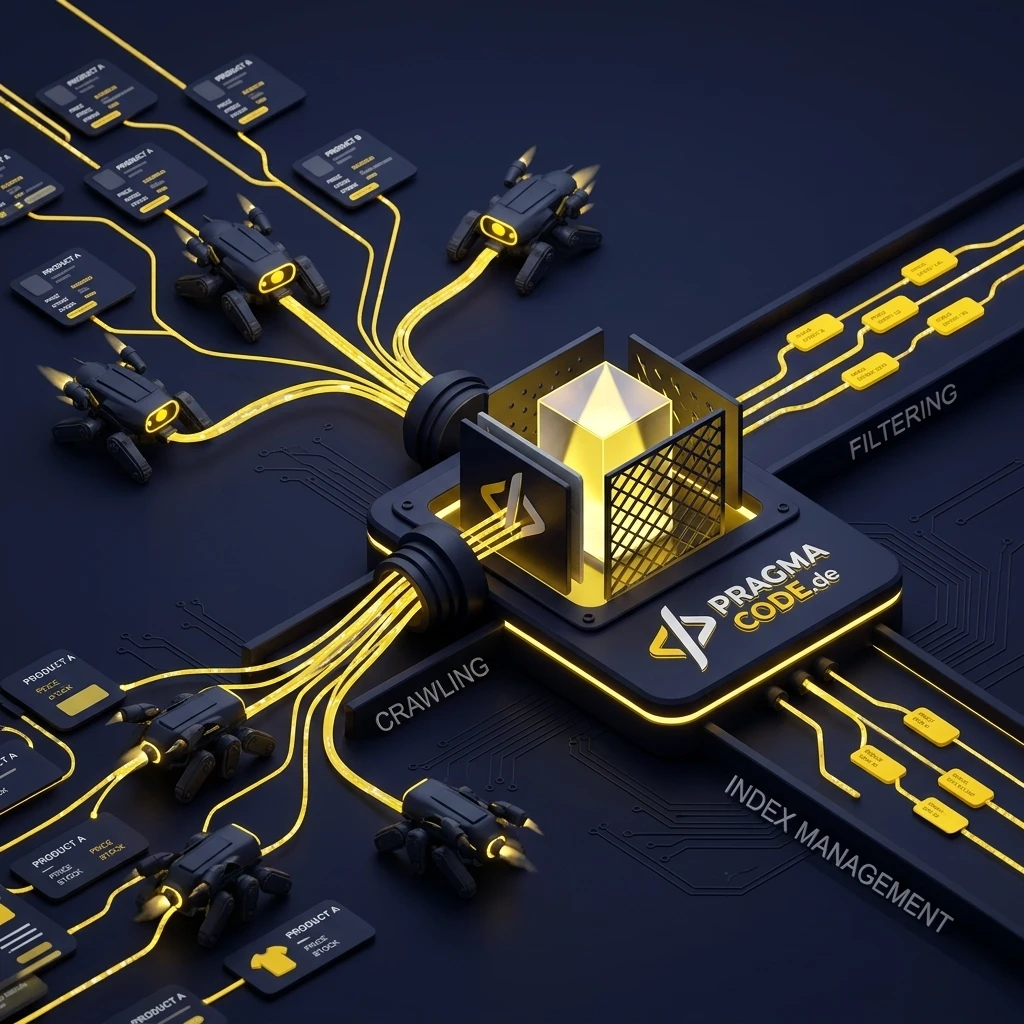

Klassische Suchmaschinen werden zunehmend von Agentic AI und Large Language Models (LLMs) wie Perplexity und SearchGPT abgelöst. Diese Systeme verzeihen technische Fehler wie Duplicate Content, Spider Traps oder chaotische URL-Strukturen durch Filter-Systeme noch weniger als traditionelle Crawler. Eine saubere Faceted Navigation ist heute nicht nur eine Frage des Crawl Budget, sondern die absolute Grundvoraussetzung, damit AI-Agenten die semantische Struktur und das Produktportfolio eines Shops überhaupt fehlerfrei erfassen und weiterempfehlen können.

- 1. Das Dilemma der Faceted Navigation

- 2. Das Kernproblem: Crawl-Budget-Verschwendung & Duplicate Content

- 3. Technische Lösungen für das Filter-Management

- 4. Das PRG-Pattern: Die absolute Königsklasse

- 5. Link-Attribute & Dofollow/Nofollow Strategien

- 6. Roadmap: Shop-Audit & Implementierung

- 7. Best Practices für die URL-Struktur im E-Commerce

- 8. Häufig gestellte Fragen (Glossar)

1. Das Dilemma der Faceted Navigation

Wer im E-Commerce erfolgreich sein will, muss seinen Kunden eine perfekte User Experience (UX) bieten. Ein zentrales Element dieser Erfahrung ist die sogenannte Faceted Navigation (zu Deutsch oft "Facettennavigation" oder einfach "Filtersystem"). Kunden erwarten, dass sie tausende von Produkten mit wenigen Klicks nach Eigenschaften wie Farbe, Größe, Preis, Marke, Material oder Verfügbarkeit filtern können. Aus Sicht der UX ist dies ein absolutes Muss und treibt die Conversion Rate signifikant in die Höhe.

Aus der Perspektive der Suchmaschinenoptimierung (SEO) ist die Faceted Navigation jedoch einer der gefährlichsten Mechanismen, die man in einem Web-Projekt implementieren kann. Warum? Wegen der sogenannten kombinatorischen Explosion. Wenn ein Shop-Betreiber nicht extrem vorsichtig ist und die Architektur präzise plant, verwandelt ein scheinbar harmloses Filtersystem einen Shop mit 10.000 Produkten in ein Monster mit Millionen von indexierbaren URLs. Suchmaschinen-Crawler wie der Googlebot verirren sich in diesen endlosen Kombinationen von Parametern, was zu massiven Indexierungsproblemen, gravierendem Duplicate Content und letztendlich zu einem dramatischen Absturz in den Suchergebnissen führt.

In diesem umfassenden Guide für Technisches SEO 2.0 analysieren wir tiefgreifend, wie Sie diese Herausforderung meistern. Wir betrachten die Mechanismen hinter Crawl-Budgets, bewerten die Effektivität von klassischen Strategien wie `rel="canonical"` und `noindex`, und stellen fortgeschrittene Architekturmuster wie das PRG Pattern (Post-Redirect-Get) vor. Ziel ist es, Ihnen das Rüstzeug an die Hand zu geben, um riesige Shopsysteme so zu strukturieren, dass sie sowohl für menschliche Käufer als auch für moderne Agentic-AI-Crawler perfekt optimiert sind.

2. Das Kernproblem: Crawl-Budget-Verschwendung & Duplicate Content

Was ist das Crawl-Budget?

Das Crawl Budget ist die maximale Anzahl von URLs, die eine Suchmaschine wie Google bereit ist, auf Ihrer Website innerhalb eines bestimmten Zeitraums zu crawlen. Dieses Budget ist nicht unendlich. Es basiert auf zwei Hauptfaktoren:

Wenn Ihr Shop nun durch Filter millionenfache URL-Kombinationen generiert, verbraucht der Crawler sein Budget damit, wertlose Filterseiten zu analysieren (z. B. "Rote Schuhe, Größe 42, Marke X, Preis 10-20€"). Das Budget ist aufgebraucht, bevor der Crawler Ihre neuen, wichtigen, hochmargigen Produkte oder frischen Blog-Artikel überhaupt erreicht. Wertvolle Seiten bleiben de-indexiert oder veraltet.

Spider Traps und die kombinatorische Explosion

Eine Spider Trap (Crawler-Falle) entsteht, wenn ein System endlos viele strukturelle URLs generiert. Ein Beispiel aus der Praxis: Angenommen, eine Kategorieseite hat 5 Filter-Dimensionen (Marke, Farbe, Größe, Material, Preis), und jede Dimension hat 10 Optionen. Wenn die Navigation erlaubt, diese beliebig zu kombinieren und die Reihenfolge der URL-Parameter variabel ist, entstehen mathematisch gesehen Millionen von einzigartigen URLs – die alle fast denselben Inhalt zeigen.

Dieses Phänomen führt unweigerlich zu Duplicate Content und im schlimmsten Fall zur Keyword-Kannibalisierung, bei der Google nicht mehr weiß, welche URL für das Keyword "Schuhe rot" relevant ist, und infolgedessen alle URLs in den Rankings herabstuft.

Der Albtraum: 1.000.000 URLs

Ein Shop ohne technisches SEO für Filter generiert exponentiell URLs.

Crawl-Budget Waste: 95%Crawler verbringen 95% der Zeit auf irrelevanten Parameter-URLs. Wichtige Produkte werden erst Wochen nach dem Launch indexiert. Serverkosten explodieren durch Bot-Traffic.

Der Idealfall: Clean Index

Ein Shop mit striktem Index-Management und PRG-Pattern.

Indexierte URLs: ~15.000Nur die echten Kategorieseiten, SEO-Landingpages und Produkte sind zugänglich. Das Crawl-Budget reicht für tägliche Updates des gesamten Katalogs. Höchste Rankings.

3. Technische Lösungen für das Filter-Management

Um das Problem der Faceted Navigation in den Griff zu bekommen, gibt es verschiedene technische Ansätze. Keine Lösung ist perfekt für alle Anwendungsfälle, weshalb eine Kombination oft am sinnvollsten ist. Die drei traditionellen Hauptwerkzeuge eines SEO-Spezialisten sind das Canonical Tag, das Meta-Robots-Tag (`noindex`) und die `robots.txt` Datei.

Die häufigste und sicherste Methode, um Filterseiten aus dem Index fernzuhalten. Das Tag signalisiert: "Nimm diese Seite nicht in den Index auf, aber folge den Links darauf zu anderen Produkten." Achtung: Nach einiger Zeit wertet Google langjährige "noindex"-Seiten als "noindex, nofollow" und folgt den Links gar nicht mehr.

Hiermit verweist man von einer Filterseite (z.B. `/kategorie?farbe=rot`) auf die Hauptkategorie (`/kategorie`). Es signalisiert: "Dies ist nur eine Kopie, gib alle Ranking-Signale an das Original." Der Nachteil: Es ist nur ein 'Hinweis' (Hint) für Google. Bei stark abweichendem Content durch Filterung wird es oft ignoriert. Zudem spart es KEIN Crawl-Budget, da Google die Seite erst crawlen muss, um das Tag zu lesen!

Durch `Disallow: /*?filter=*` in der robots.txt verbieten Sie dem Crawler hart den Zugriff auf Parameter-URLs. Das spart sofort 100% des Crawl-Budgets für diese Pfade. Gefahr: Google kann keine Links auf diesen gesperrten Seiten crawlen. Wenn wichtige Produkte nur über Filter-Pfade erreichbar sind, werden sie nicht indexiert (Orphan Pages).

Wann nutzt man Canonical vs. Noindex?

Die Debatte zwischen Canonical und Noindex ist ein Klassiker im Technischen SEO. Als Faustregel im E-Commerce gilt im Jahr 2026: Wenn eine Filterkombination für die Nutzer relevant ist, aber keinen signifikanten, eigenständigen Mehrwert für Suchmaschinen bietet (z. B. "Schuhe, Rot, Größe 42, Sortierung: Preis aufsteigend"), sollte sie mit einem `noindex, nofollow` (oder `noindex, follow` mit den oben genannten Einschränkungen) versehen werden. Noch besser ist es, diese Links gar nicht erst für Crawler zugänglich zu machen (siehe PRG-Pattern im nächsten Kapitel).

Das Canonical Tag sollten Sie reservieren für leicht veränderte URLs, die absolut identischen Inhalt zeigen, beispielsweise Tracking-Parameter (`?utm_source=...`) oder Session-IDs. Für echte Faceted Navigation ist das Canonical-Tag allein zu schwach und verschwendet weiterhin massiv Crawl-Budget.

Code-Beispiel für eine korrekte Canonical-Implementierung in Astro/Next.js:

<head>

<!-- Auf der Seite: /kategorie/sneaker?farbe=rot&sort=preis -->

<link rel="canonical" href="https://www.shop.de/kategorie/sneaker" />

<meta name="robots" content="noindex, follow" />

</head>Diese Kombination (Canonical + Noindex) galt lange als "doppelt gemoppelt", wird aber von vielen Experten heute als robuste Absicherung empfohlen, falls die Suchmaschine eines der Signale ignoriert. Letztendlich lösen aber weder Canonical noch Noindex das Problem der verschwendeten Server-Ressourcen beim Crawling.

4. Das PRG-Pattern: Die absolute Königsklasse

Um das Crawl-Budget-Problem der Facettennavigation endgültig und elegant zu lösen, setzen moderne Enterprise-Shops auf das PRG Pattern (Post-Redirect-Get). Diese Architektur wurde ursprünglich entwickelt, um doppelte Formular-Übermittlungen (das lästige "Wollen Sie das Formular erneut senden?") zu vermeiden. Im SEO-Kontext ist es eine geniale Methode, um Filter-Links für Crawler unsichtbar zu machen, ohne die Benutzerfreundlichkeit zu beeinträchtigen.

Wie das PRG Pattern funktioniert

Im Gegensatz zu normalen `<a href="...">` Links, denen ein Crawler gnadenlos folgt, werden Filter beim PRG-Pattern als HTML-Formulare übermittelt, und zwar mit der Methode `POST`.

POST-Request

Der Nutzer klickt auf einen Filter (z.B. Checkbox "Rot"). Das Frontend sendet einen POST-Request an den Server. Suchmaschinen-Crawler füllen niemals POST-Formulare aus, da dies den Serverstatus verändern könnte. Für den Bot existiert der Link quasi nicht.

REDIRECT

Der Server empfängt den POST-Request, berechnet die neue Filter-URL (z. B. /kategorie?color=red) und antwortet mit einem HTTP Status Code 302 oder 303 (See Other) Redirect auf diese neue URL.

GET-Request

Der Browser des Nutzers folgt dem Redirect und führt einen normalen GET-Request auf die neue Filter-URL aus. Die gefilterten Produkte werden angezeigt.

Der gigantische SEO-Vorteil: Da Suchmaschinen keine POST-Requests ausführen, sehen sie die Millionen von Filterkombinationen gar nicht erst. Es gibt keine Links im Quelltext, denen sie folgen können. Das Crawl-Budget wird zu 100% geschont, und es entsteht kein Duplicate Content. Gleichzeitig funktioniert das System für den menschlichen Nutzer reibungslos – und sogar barrierefrei, da native Formular-Elemente verwendet werden.

In modernen JavaScript-Frameworks wie React, Vue oder Next.js wird das PRG-Pattern oft nicht mehr streng über Server-Side HTTP-Redirects gelöst, sondern über Client-Side-Routing (z.B. router.push()) gekoppelt mit <button>-Elementen anstelle von <a>-Tags. Da Googlebot Buttons ohne href-Attribut in der Regel nicht klickt, erzielt dies denselben SEO-Effekt. Man spricht hierbei vom "virtuellen PRG-Pattern".

5. Link-Attribute & Dofollow/Nofollow Strategien

Falls ein komplettes Refactoring der Shop-Architektur auf das PRG-Pattern zu teuer oder technisch (noch) nicht machbar ist, greifen viele SEOs zu HTML-Link-Attributen, um den Crawler zu steuern. Das bekannteste Attribut hierfür ist `rel="nofollow"`.

rel="nofollow" Der Filter-Blocker

Wird an Links angehängt, denen der Crawler nicht folgen soll (z.B. Sortier-Links "Preis aufsteigend").

rel="dofollow" (Standard) SEO Landingpages

Wird für Filter genutzt, die als eigene Keyword-Landingpages ranken sollen (z.B. "Rote Schuhe").

Das Problem mit `nofollow` im Jahr 2026: Google betrachtet `nofollow` mittlerweile nur noch als "Hinweis" (Hint), nicht mehr als strikte Direktive. Das bedeutet, Google kann sich entscheiden, dem Link trotzdem zu folgen, wenn die Algorithmen es für sinnvoll erachten. Dennoch ist es ein starkes Signal.

Ein weiteres oft diskutiertes Thema ist das sogenannte "PageRank Sculpting". Früher dachte man, man könne durch `nofollow` auf Filter-Links den "Link Juice" (die PageRank-Energie) der Seite auf die wichtigen Produktlinks bündeln. Diese Theorie ist längst veraltet. Die Energie eines Nofollow-Links verpufft einfach, sie wird nicht auf andere Links umverteilt. Daher ist Nofollow zwar nützlich für das Crawl-Budget, aber kein Wundermittel für besseres Ranking.

6. Roadmap: Shop-Audit & Implementierung

Die theoretischen Konzepte sind klar. Doch wie gehen Sie konkret vor, wenn Sie einen bestehenden, organisch gewachsenen E-Commerce-Shop mit akuten Indexierungsproblemen analysieren und reparieren müssen? Hier ist der professionelle Workflow für ein technisches SEO-Audit der Faceted Navigation.

Logfile-Analyse & Status Quo

Laden Sie die Server-Logfiles (Apache, Nginx, Varnish) der letzten 30 Tage herunter. Analysieren Sie diese mit Tools wie Screaming Frog Log File Analyser oder Splunk. Suchen Sie nach dem User-Agent "Googlebot". Identifizieren Sie, welche Parameter-URLs am häufigsten gecrawlt werden. Oft finden Sie hier zehntausende Aufrufe auf obskure Filterkombinationen, während Ihre Top-Produkte ignoriert werden.

Identifikation der SEO-relevanten Facetten

Nicht alle Filter sind SEO-Gift. Manche Filter-Kombinationen haben ein hohes Suchvolumen und sollten als eigenständige Landingpages existieren. Zum Beispiel: Die Kategorie "Schuhe" gefiltert nach der Farbe "Rot" und Marke "Nike" bedient die Suchanfrage "Nike Schuhe rot". Diese Facetten müssen indexierbar bleiben, eigene sprechende URLs (Clean URLs) erhalten und optimierte H1-Überschriften aufweisen. Alle anderen Kombinationen (z.B. Preis 20-30€, Größe 42) sind für SEO irrelevant.

Implementierung der Sperrmechanismen

Für alle irrelevante Filter: Setzen Sie das Meta-Tag auf noindex und stellen Sie sicher, dass das Canonical-Tag auf die übergeordnete Kategorie zeigt. Für radikale Crawl-Budget-Einsparungen blockieren Sie unwichtige Parameter-Muster in der robots.txt. Evaluieren Sie, ob das PRG Pattern durch Ihre Entwicklungsagentur umsetzbar ist.

Monitoring und Re-Evaluation via Search Console

Überwachen Sie den Bericht "Seitenindexierung" in der Google Search Console streng. Die Anzahl der URLs unter "Gecrawlt – zurzeit nicht indexiert" und "Ausgeschlossen durch noindex-Tag" sollte massiv ansteigen, während die Fehler bei der Indexierung wichtiger Produktseiten drastisch abnehmen müssen. Achten Sie auf den Indexierungs-Status im Laufe der kommenden Wochen.

7. Best Practices für die URL-Struktur im E-Commerce

Die Art und Weise, wie URLs in Ihrem Shop generiert werden, entscheidet oft über den Erfolg Ihrer SEO-Strategie. Suchmaschinen bevorzugen saubere, verständliche Hierarchien. Vermeiden Sie endlose Query-Parameter-Ketten. Vergleichen Sie diese beiden Ansätze:

https://www.shop.de/katalog?category=123&brand=nike&color=red&sort=price_asc https://www.shop.de/schuhe/nike/rot/ https://www.shop.de/schuhe/nike/rot/?sort=price_asc&size=42 wobei size=42 im PRG-Pattern läuft oder noindex ist

Im hybriden Ansatz werden SEO-relevante Dimensionen (Kategorie, Marke, Hauptfarbe) in den URL-Pfad (die sogenannten "Clean URLs") integriert. Diese Seiten sind indexierbar, haben optimierte Meta-Tags und einzigartige Texte. Alle flüchtigen, temporären oder Nutzer-spezifischen Filter (Größe, Sortierung, Preisspanne) werden als Query-Parameter (?) angehängt. Diese Parameter-URLs werden dann strikt per `noindex` und `robots.txt` vom Index ferngehalten oder idealerweise per PRG-Pattern versteckt.

Diese architektonische Trennung zwischen "Inhalt" (Pfad) und "Ansicht/Zustand" (Parameter) ist das Geheimnis erfolgreicher E-Commerce SEO-Strategien bei Marktführern wie Zalando, AboutYou oder Otto.

Zusammenfassend lässt sich sagen: Technisches SEO im E-Commerce ist kein einmaliges Projekt, sondern eine kontinuierliche technische Disziplin. Die Bewältigung der Faceted Navigation erfordert eine enge Zusammenarbeit zwischen SEO-Spezialisten, Data Analysts und Software-Architekten. Wer hier in moderne Ansätze wie das PRG-Pattern und striktes Index-Management investiert, legt das Fundament für massive organische Skalierung – und sichert sich den entscheidenden Wettbewerbsvorteil in der Ära von Agentic AI und Generative Search.

Haben Sie Fragen zur Shop-Architektur?

Kostenlose Erstberatung vereinbaren8. Häufig gestellte Fragen (Glossar)

Was ist Faceted Navigation?

Faceted Navigation (Facettennavigation) ist ein User-Interface-Muster, das es Benutzern ermöglicht, Ergebnisse durch die Anwendung mehrerer Filter (Facetten) wie Farbe, Größe oder Marke gleichzeitig einzugrenzen. Es ist essenziell für die E-Commerce UX, aber riskant für SEO.

Was ist Crawl Budget?

Das Crawl Budget bezeichnet die Anzahl der URLs, die ein Suchmaschinen-Bot (wie der Googlebot) auf einer Website in einem bestimmten Zeitraum crawlen kann und will. Es wird stark durch die Server-Performance und die Popularität der Domain beeinflusst.

Was ist das Canonical Tag?

Das Canonical Tag (`rel="canonical"`) ist ein HTML-Element, das Suchmaschinen mitteilt, welche URL die "Hauptversion" (kanonische Version) einer Seite ist, wenn ähnlicher oder identischer Inhalt unter verschiedenen URLs erreichbar ist, um Duplicate Content zu vermeiden.

Was ist das PRG Pattern?

Das Post-Redirect-Get (PRG) Pattern ist ein Webentwicklungsmuster. Im SEO wird es genutzt, um Filter-Links als POST-Formulare abzusenden, die vom Server via Redirect auf eine GET-URL weitergeleitet werden. Da Bot-Crawler keine POST-Requests ausführen, bleiben die endlosen Filterkombinationen für sie unsichtbar.

Was ist eine Spider Trap?

Eine Spider Trap (Crawler-Falle) ist ein struktureller Fehler auf einer Website, der dazu führt, dass Crawler in einer endlosen Schleife dynamisch generierter URLs gefangen werden (oft durch Kalender oder komplexe Filter-Systeme), was massiv Crawl-Budget verschwendet.

Aktuelle Insights & Fachartikel

High-Performance WooCommerce

Wie Sie Ladezeiten optimieren und Core Web Vitals für Ihren Shop perfektionieren.

Weiterlesen →

E-Commerce Trends 2026

Die Zukunft des Online-Handels: Headless, Agentic AI und Composable Commerce.

Weiterlesen →Noch mehr Fachbegriffe?

Besuchen Sie unseren zentralen Glossar Hub für alle IT-Fachbegriffe von A bis Z.