Einleitung: Warum "Frontier Deployment" heute wichtiger ist als je zuvor

In einer Welt, in der täglich neue Sprachmodelle (LLMs) wie GPT-5.4, Claude 4.6 oder Llama 4 auf den Markt kommen, stellt sich für Unternehmen eine entscheidende Frage: Wie verwandelt man diese rohe Rechenpower in echten Geschäftswert? Die Antwort liegt nicht in der KI selbst, sondern in der Art und Weise, wie sie implementiert wird. Hier komme ich als Frontier Deployment Engineer ins Spiel.

Als Gründer von Pragma Code verkörpere ich diese Rolle leidenschaftlich. Für mich geht es nicht nur darum, Code zu schreiben; es geht darum, die "Last Mile" der KI-Integration zu überwinden. Es ist die Disziplin, modernste Modelle an der vordersten Front (die "Frontier") so einzusetzen, dass sie robuste, skalierbare und vor allem sichere Unternehmensprozesse ermöglichen.

Was ist ein Frontier Deployment Engineer? Ein neues Berufsfeld definiert

Bevor wir tief in die Praxis eintauchen, möchte ich klären, was diese Rolle eigentlich bedeutet. Ein herkömmlicher Softwareentwickler baut Anwendungen. Ein Data Scientist trainiert Modelle. Ein Frontier Deployment Engineer hingegen ist das entscheidende Bindeglied.

Die drei Säulen der Deployment-Exzellenz

Modell-Expertise

Das Verständnis dafür, welches Modell (Open Source vs. Closed Source) für welche Aufgabe am besten geeignet ist. Es geht um Latenz, Kosten und vor allem Datenschutz.

Infrastruktur-Design

Der Aufbau von Systemen, die nicht nur eine "Chat-Blase" sind, sondern tief in die bestehende IT-Landschaft integriert sind.

Agentic Workflows

Die Entwicklung von autonomen Agenten, die Aufgaben nicht nur planen, sondern auch ausführen – von der API-Abfrage bis zur Datenbank-Mutation.

Der Begriff beschreibt die Bereitstellung von KI-Lösungen an der Grenze des technisch Machbaren, wobei der Fokus auf maximaler Zuverlässigkeit und geschäftlichem Nutzen liegt.

Mein Weg: Vom Mechatroniker zum KI-Architekten

Mein Werdegang ist kein klassischer geradliniger IT-Pfad. Und genau das ist meine Stärke. Mit meinem Hintergrund in der Mechatronik (Studium an der Hochschule Osnabrück) bringe ich ein tiefes Verständnis für komplexe Systeme und physikalische Kausalitäten mit.

Mechatronik als Fundament digitaler Systeme

Warum ist Mechatronik für KI relevant? In der Mechatronik lernt man, wie mechanische, elektronische und informationstechnische Komponenten in einem geschlossenen Regelkreis zusammenwirken. Ein moderner KI-Agent ist im Grunde nichts anderes: Er nimmt Informationen wahr (Sensorik/Eingabe), verarbeitet sie (Logik/KI) und führt eine Aktion aus (Aktorik/Output). Dieses Systemverständnis erlaubt es mir, Automatisierungen zu bauen, die nicht nur "einfache Scripte" sind, sondern sich selbst regulierende Prozesse.

Analyse

Durchleuchtung komplexer Legacy-Systeme auf Automatisierbarkeit.

Bauweise

Modulare Architektur für maximale Skalierbarkeit und Wartbarkeit.

Launch

Sicheres Deployment in Produktivumgebungen ohne Ausfallzeiten.

Das "Pragma" in Pragma Code: Eine Philosophie der Umsetzung

Warum Pragma Code? Weil Theorie in der IT oft teuer ist, aber Praxis (Pragmatismus) den Erfolg bringt. In der Zusammenarbeit mit mir merken Kunden schnell: Hier geht es nicht um Buzzwords, sondern um messbare Effizienz.

"KI ist kein Selbstzweck. Wenn eine n8n-Automatisierung oder ein lokales Sprachmodell Ihre Betriebskosten nicht senkt oder Ihre Qualität nicht massiv steigert, dann ist es Spielerei, keine Strategie." — Alexander Ohl

Ausführung von Modellen auf eigener Hardware oder in geschützten Cloud-Umgebungen im DACH-Raum.

Nutzung von Modellen wie Mistral oder Llama, um maximale Kontrolle über die Logik und den Datenschutz zu behalten.

Jede Lösung wird so gebaut, dass der Kunde sie versteht und im Idealfall selbst erweitern kann.

Technologischer Deep Dive: Mein Arsenal als Frontier Deployment Engineer

Ich nutze ein kuratiertes Set an Technologien, das Flexibilität mit Stabilität verbindet. Hier tauchen wir tiefer in die technische Architektur ein.

1. n8n: Das Gehirn der Automatisierung

Für mich ist n8n nicht nur ein Tool, sondern das Betriebssystem für moderne Agenten. Es erlaubt die nahtlose Verbindung von über 400 Apps mit KI-Logiken. Im Gegensatz zu Zapier bietet n8n die nötige Tiefe für komplexe "Loops" und Fehlerbehandlung. Ein besonderer Vorteil ist die Möglichkeit des Self-Hostings, was für Unternehmen mit hohen Anforderungen an den Datenschutz (DSGVO) essenziell ist.

2. Python & Agentic Frameworks

Wenn Standard-Tools an ihre Grenzen stoßen, kommt Python ins Spiel. Ich entwickle maßgeschneiderte Scripte und nutze Frameworks wie LangChain oder CrewAI, um Multi-Agenten-Systeme zu koordinieren. Diese Systeme können komplexe Aufgaben wie "Marktforschung", "Content-Erstellung" und "Proofreading" völlig autonom durchführen.

3. Vektor-Datenbanken & RAG (Retrieval Augmented Generation)

Eines der größten Probleme von KI ist das "Halluzinieren". Ich löse dies durch RAG. Hierbei wird das Wissen des Unternehmens (PDFs, Wikis, Datenbanken) in Vektoren umgewandelt. Die KI greift dann in Echtzeit auf diese Fakten zu, bevor sie eine Antwort generiert. Dies garantiert, dass die KI nur auf Basis gesicherter Informationen antwortet.

Sicheres Einlesen von Unternehmensdaten aus verschiedenen Quellen wie SharePoint, Google Drive oder lokalen Servern.

Umwandlung von Text in mathematische Vektoren für semantische Suche mittels spezialisierter Modelle.

Implementierung eines Caches, der wiederkehrende Fragen sofort beantwortet und so Token-Kosten spart.

Ein nachgeschalteter Agent prüft die Antwort der KI auf Übereinstimmung mit den Quelldokumenten.

Case Study: Von 48 Stunden auf 48 Sekunden

Ein reales Beispiel aus meiner Praxis zeigt die Macht des Frontier Deployments. Ein mittelständisches Unternehmen im Bereich IT-Services hatte das Problem, dass die Qualifizierung von Projektanfragen manuell über zwei Tage dauerte. Durch den Einsatz eines von mir entwickelten Agenten-Systems wurde dieser Prozess auf unter eine Minute reduziert.

Anfrage-Eingang

Ein Agent überwacht neue E-Mails und extrahiert die Kernanforderungen mittels NLP (Natural Language Processing).

Matching & Recherche

Ein spezialisierter Recherche-Agent prüft im CRM und auf der Website des Absenders die Relevanz des Projekts und zieht historische Daten heran.

Score & Entwurf

Die KI vergibt einen Prioritäts-Score basierend auf vordefinierten Business-Logiken und erstellt einen ersten Antwortentwurf für den Vertrieb.

Menschliche Freigabe

Der Senior-Berater erhält eine fertige Entscheidungsgrundlage inklusive Quellenangaben und muss nur noch "Senden" klicken.

Deep Dive: RAG vs. Fine-tuning – Ein technologisches Duell

Oft werde ich gefragt: "Sollten wir ein eigenes Modell trainieren oder reicht ein Prompt?" Als Frontier Deployment Engineer ist meine Antwort fast immer: "RAG first, Fine-tuning second."

RAG (Retrieval Augmented Generation) erlaubt es der KI, in Echtzeit in "Büchern" (Ihren Daten) nachzuschlagen. Wenn sich Ihre Preisliste ändert, aktualisieren Sie einfach das Dokument im Vektor-Speicher. Die KI weiß es sofort. Beim Fine-tuning hingegen müsste das Modell neu trainiert werden – ein teurer und langsamer Prozess, der zudem das Risiko von veralteten Informationen birgt.

Fine-tuning ist für mich das Skalpell. Es wird eingesetzt, um den Tonfall (Brand Voice) oder extrem spezifische Formate (z.B. medizinische Berichte oder juristische Schriftsätze) zu lehren, die die KI von Haus aus nicht beherrscht. In der Praxis kombiniere ich oft beide Ansätze: Ein fine-getuntes Modell, das mittels RAG auf aktuelle Daten zugreift. Dies ist das "State-of-the-Art" Deployment.

Agentic Design Patterns: Wie KI-Systeme "denken"

Ein Frontier Deployment Engineer baut keine linearen Scripte. Er baut Muster. Ich nutze hierbei bewährte "Agentic Design Patterns", um die Zuverlässigkeit zu erhöhen:

Sicherheit & Compliance: Der EU AI Act und Datenschutz (DSGVO)

In der DACH-Region ist Vertrauen die wichtigste Währung. Ich stelle sicher, dass jedes Deployment den strengen Anforderungen entspricht. Dies beinhaltet nicht nur die technische Verschlüsselung, sondern auch die rechtliche Absicherung.

Security Checklist für KI-Deployments

Anonymisierung

Automatisches Filtern von personenbezogenen Daten, bevor diese an Cloud-LLMs gesendet werden.

Guardrails

Implementierung von Filtern, die verhindern, dass die KI unangemessene oder schädliche Inhalte generiert.

Audit Logs

Vollständige Protokollierung aller KI-Entscheidungen zur Nachvollziehbarkeit und für Audits.

Mit dem kommenden EU AI Act werden die Anforderungen an Transparenz und Risikomanagement weiter steigen. Ich berate Unternehmen dabei, ihre KI-Infrastruktur so aufzubauen, dass sie "Compliance-ready" ist. Dies schützt vor massiven Bußgeldern und sorgt für eine nachhaltige IT-Strategie.

Die Zukunft: Der Weg zum "Autonomous Business"

Wohin geht die Reise? Für mich ist klar: Wir stehen erst am Anfang. In den nächsten 24 Monaten werden wir den Übergang von assistierender KI zu autonomer KI erleben. Unternehmen, die jetzt die Infrastruktur (das Deployment) richtig aufsetzen, werden uneinholbare Wettbewerbsvorteile haben.

Roadmap für Ihr KI-Deployment

Phase 1: Audit & Strategie

Identifikation der effizientesten Hebel für Automatisierung innerhalb der bestehenden Prozesse.

Phase 2: MVP Development (Prototyping)

Schnelle Umsetzung eines ersten Pilotprojekts in n8n, um den Mehrwert sofort sichtbar zu machen.

Phase 3: Deep Integration

Nahtlose Anbindung an CRM, ERP und Legacy-Systeme sowie Schulung der beteiligten Mitarbeiter.

Phase 4: Scaling & Security Hardening

Rollout auf das gesamte Unternehmen und finale Absicherung der Datenströme gegen externe Angriffe.

Zusammenfassung: Erfolg ist kein Zufall, sondern Konfiguration

Mein Frontier Deployment Engineer-Konzept ist die Antwort auf die Komplexität der modernen Welt. Es geht nicht darum, der KI blind zu vertrauen, sondern ein System zu bauen, in dem KI ihre Stärken ausspielt und der Mensch die Kontrolle behält. Bei Pragma Code erhalten Sie keine Lösungen von der Stange, sondern maßgeschneiderte digitale Werkzeuge, die Ihr Unternehmen transformieren.

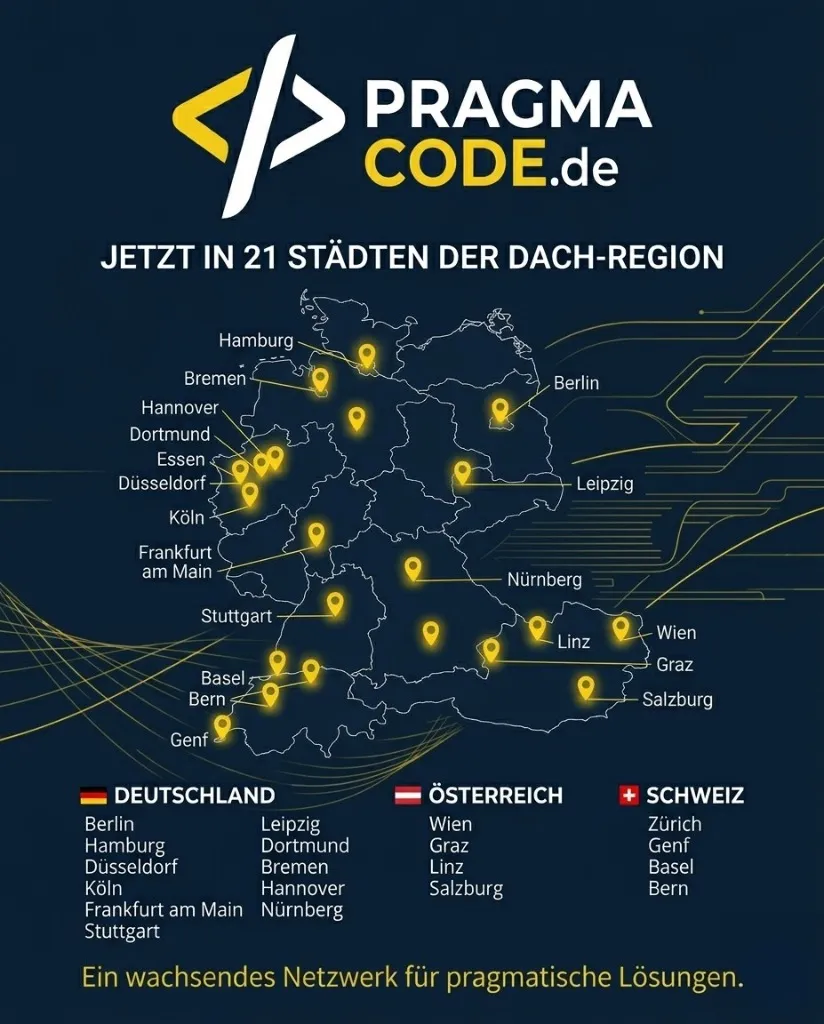

Unsere Expertise vor Ort

Wir sind Ihr digitaler Partner – regional verankert und überregional erfolgreich.

Aktuelle Insights & Fachartikel

Software as a Product (SaaP)

Wie Pragma-Code das SaaP-Modell lebt und warum es der Schlüssel zu nachhaltiger IT ist.

Weiterlesen →

Agentic AI Workflows 2026

Wie autonome KI-Agenten die Effizienz im Mittelstand neu definieren.

Weiterlesen →

KI-Integration im Mittelstand

Strategien und Praxis für die erfolgreiche KI-Einführung in KMU.

Weiterlesen →Haben Sie eine Vision?

Lassen Sie uns gemeinsam prüfen, wie wir Ihre Idee zum Fliegen bringen.

Jetzt kostenloses Strategiegespräch buchenErweitertes Fachglossar

Agentic Workflow

Ein Prozess, bei dem KI-Agenten autonom Entscheidungen treffen und Tools (APIs, Browser, Scripte) nutzen, um ein vordefiniertes Ziel zu erreichen.

Retrieval Augmented Generation (RAG)

Eine Technik, um LLMs mit externen, gesicherten Daten zu füttern. Die KI "liest" die Dokumente erst, bevor sie antwortet, was Halluzinationen minimiert.

Local Deployment

Die Installation und der Betrieb von KI-Modellen auf eigenen Servern oder in privaten Clouds, um maximale Datensouveränität zu gewährleisten.

Prompt Engineering

Die Kunst und Wissenschaft, Eingabebefehle so zu strukturieren, dass die KI präzise, korrekte und nützliche Ergebnisse liefert.

Frontier Models

Die leistungsfähigsten KI-Modelle am Markt (wie GPT-5.4 oder Claude 4.6), die an der Grenze der aktuellen technischen Leistungsfähigkeit stehen.

Token-Optimierung

Techniken zur Reduzierung der Datenmenge, die an die KI gesendet wird, um Kosten zu senken und die Verarbeitungsgeschwindigkeit zu erhöhen.

Vector Database

Eine spezialisierte Datenbank, die Informationen mathematisch speichert, um der KI Blitzschnelles Suchen in Millionen von Dokumenten zu ermöglichen.

Halluzination

Ein Phänomen, bei dem eine KI Fakten erfindet, die plausibel klingen, aber falsch sind. RAG ist das effektivste Gegenmittel.