Die Europäische Union hat mit dem **AI Act (KI-Verordnung)** einen globalen Meilenstein gesetzt. Es ist das weltweit erste umfassende Gesetz zur Regulierung Künstlicher Intelligenz, das weitreichende Auswirkungen auf Unternehmen jeder Größe hat. Oft als "DSGVO für KI" bezeichnet, zielt die Verordnung darauf ab, sicherzustellen, dass in der EU eingesetzte KI-Systeme sicher, ethisch vertretbar und im Einklang mit den Grundrechten stehen.

Für den deutschen Mittelstand (KMU) bedeutet dies eine Zäsur. Während die letzten Jahre von Experimentierfreude und dem rasanten Einzug von Werkzeugen wie ChatGPT geprägt waren, tritt nun eine Phase der Professionalisierung und regulatorischen Verantwortung ein. Ab 2026 werden die meisten Bestimmungen verbindlich. Wer sich nicht rechtzeitig vorbereitet, riskiert nicht nur horrende Bußgelder, sondern auch den Ausschluss aus Lieferketten großer Konzerne, die ihre Zulieferer bereits jetzt auf AI Act Compliance prüfen.

Einleitung: Warum der AI Act die digitale Wirtschaft verändert

Künstliche Intelligenz ist keine ferne Zukunftsmusik mehr. Sie ist in unseren Arbeitsalltag integriert – von der automatisierten Rechnungsverarbeitung bis hin zur KI-gestützten Kundenkommunikation. Doch mit der Macht der Algorithmen wachsen auch die Risiken: Diskriminierung durch voreingenommene Daten, mangelnde Transparenz bei Entscheidungen oder die Gefahr von Manipulationen.

Der AI Act folgt einem **risikobasierten Ansatz**. Das bedeutet: Je höher das Risiko eines KI-Systems für die Gesellschaft, desto strenger die Regeln. Während ein einfacher Spam-Filter kaum reguliert wird, unterliegen KI-Systeme im HR-Bereich oder in der kritischen Infrastruktur massiven Auflagen.

"Der AI Act ist kein Innovationskiller, sondern ein Vertrauensanker. In einer Welt, in der KI-Content und -Entscheidungen allgegenwärtig sind, wird die zertifizierte Sicherheit zum wichtigsten Wettbewerbsfaktor für 'Made in Europe'."

Der Fahrplan bis 2027: Wichtige Fristen im Überblick

Unternehmen haben keine Zeit zu verlieren. Die Umsetzung erfolgt in mehreren Stufen, wobei die ersten Verbote bereits kurz nach Inkrafttreten greifen.

Sämtliche als "unannehmbar" eingestuften KI-Praktiken sind ab diesem Datum untersagt. Dazu gehören unter anderem Social Scoring, biometrische Fernidentifizierung in Echtzeit (mit Ausnahmen) und Manipulations-KI. Zudem müssen Unternehmen ab diesem Zeitpunkt ihre **KI-Kompetenz** (AI Literacy) nachweisen können – Mitarbeiter müssen also geschult sein.

Regeln für Basismodelle wie GPT-5.5 oder Llama treten in Kraft. Provider müssen technische Dokumentationen vorlegen und Urheberrechtsvorgaben einhalten. Modelle mit "systemischen Risiken" (hohe Rechenleistung) müssen zusätzliche Evaluierungen und Incident-Reporting leisten.

Die meisten Regelungen für **Hochrisiko-Systeme** (Annex III) werden verbindlich. Dazu zählen Anwendungen in der Bildung, im Personalwesen oder bei der Kreditwürdigkeitsprüfung. KMU müssen bis hierhin ihre Compliance-Management-Systeme implementiert haben.

KI-Systeme, die als Sicherheitskompomenten in Produkten verbaut sind (z.B. Medizintechnik, Aufzüge, Spielzeug), müssen nun die volle Konformität gemäß den geltenden Sektorenregeln und dem AI Act aufweisen.

Das Herzstück: Die 4 Risiko-Kategorien im Detail

Um zu verstehen, welche Pflichten auf Sie zukommen, müssen Sie Ihre KI-Anwendungen klassifizieren. Der AI Act unterscheidet vier Stufen:

1. Unannehmbares Risiko

Diese Systeme sind in der EU **vollständig verboten**. Hierzu zählen KI zur Verhaltensmanipulation, Social Scoring durch staatliche Stellen und biometrische Echtzeit-Überwachung in der Öffentlichkeit. Pflicht: Sofortige Deaktivierung solcher Systeme bis Februar 2025.

2. Hochrisiko-Systeme

Dies ist der Bereich mit den umfangreichsten Anforderungen. Er umfasst KI in sensiblen Sektoren wie HR (Recruiting), Bankwesen (Kreditscoring), Justiz und kritischer Infrastruktur. Anforderungen: Risikomanagement, Daten-Governance, Dokumentation, menschliche Aufsicht.

3. Begrenztes Risiko / Transparenz

Hierzu zählen klassische Chatbots, Emotionserkennungssysteme oder Generative KI (Bilder, Texte). Die Hauptpflicht ist hier die **Transparenz**: Der Nutzer muss wissen, dass er mit einer Maschine interagiert oder dass Inhalte KI-generiert sind (Watermarking).

4. Minimales Risiko

Die Mehrheit der heute genutzten KI (Spam-Filter, Videospiele, einfache Optimierungstools) fällt hierunter. Für diese Systeme gelten keine spezifischen rechtlichen Pflichten, jedoch werden freiwillige Verhaltenskodizes zur Förderung der Qualität empfohlen.

Deep Dive: Hochrisiko-Sektoren nach Annex III

Viele KMU unterschätzen, wie schnell sie in die "Hochrisiko-Falle" tappen können. Hier sind die kritischsten Bereiche für den Mittelstand:

Software, die Bewerbungen filtert, Kandidaten bewertet oder über Beförderungen mitentscheidet, ist fast immer Hochrisiko.

KI-Systeme zur Bewertung von Schülern oder Studenten oder zur Zuweisung zu Bildungsangeboten.

Bestimmung der Kreditwürdigkeit (Credit Scoring) oder Bewertung von Versicherungsanträgen und privaten Dienstleistungen.

KI, die im Management von Wasser, Gas, Strom oder Verkehr eingesetzt wird und die Sicherheit gefährden könnte.

General Purpose AI (GPAI): Was KMU wissen müssen

GPAI-Modelle sind KI-Modelle, die für eine Vielzahl von Aufgaben eingesetzt werden können (z.B. Foundation Models). Der AI Act unterscheidet hier zwischen normalen Modellen und solchen mit **systemischen Risiken**.

Modelle, die mit einer Rechenleistung von mehr als 10^25 FLOPs trainiert wurden (wie GPT-5.5), unterliegen strengeren Regeln. Provider müssen hier nicht nur technische Dokumentationen und Urheberrechts-Zusammenfassungen liefern, sondern auch adversarial Testing durchführen und Sicherheitsvorfälle an das EU AI Office melden.

Die 6 Säulen der Compliance für Hochrisiko-KI

Falls Ihr Projekt als Hochrisiko eingestuft wird, müssen Sie folgende technische und organisatorische Maßnahmen (TOMs) umsetzen:

Ein kontinuierlicher Prozess über den gesamten Lebenszyklus der KI, um bekannte und vorhersehbare Risiken zu identifizieren, zu bewerten und durch technische Maßnahmen zu minimieren.

Trainingsdaten müssen relevant, repräsentativ und so weit wie möglich fehlerfrei sein. Besonderer Fokus liegt auf der Erkennung und Korrektur von Vorurteilen (Bias-Mitigation), um Diskriminierung zu verhindern.

Detaillierte Unterlagen, die Behörden belegen, wie das System funktioniert, welche Architektur es nutzt und wie die Konformität sichergestellt wird. Dies muss vor dem Inverkehrbringen fertiggestellt sein.

Die KI muss technisch in der Lage sein, automatisch Ereignisse (Logs) aufzuzeichnen. Dies ermöglicht die Rückverfolgbarkeit von Entscheidungen, falls es zu Fehlern oder Diskriminierung kommt.

Anwender müssen klare Gebrauchsanweisungen erhalten, die über Fähigkeiten, Grenzen und notwendige menschliche Aufsicht informieren. Der menschliche Anwender muss die Ergebnisse verstehen können.

KI-Systeme dürfen nicht autonom über Schicksale entscheiden. Es muss immer eine "menschliche Kontrolle" (Human-in-the-loop) möglich sein, um Entscheidungen zu stoppen oder zu ignorieren.

Spezielle Unterstützung für KMU: Die "Sandboxes"

Der EU AI Act erkennt an, dass der Mittelstand weniger Ressourcen hat als Big-Tech-Konzerne. Daher wurden spezielle Schutzmechanismen eingebaut:

Mitgliedstaaten schaffen kontrollierte Umgebungen, in denen KMU ihre KI-Lösungen unter Aufsicht testen können – mit Erleichterungen bei der Dokumentation.

Konformitätsbewertungsstellen müssen ihre Gebühren für KMU proportional gestalten, um den finanziellen Aufwand zu begrenzen.

Die EU-Kommission stellt standardisierte und vereinfachte Formulare für die technische Dokumentation bereit, um KMU zu entlasten.

Haftung, Bußgelder und persönliche Verantwortung

Die Sanktionen bei Nichtbeachtung sind drastisch und übertreffen teilweise die der DSGVO:

oder 7 % des weltweiten Jahresumsatzes (je nachdem, welcher Betrag höher ist).

oder 3 % des Jahresumsatzes bei Verletzung von Governance- oder Dokumentationspflichten.

oder 1,5 % des Jahresumsatzes bei irreführenden Informationen gegenüber Behörden.

Entscheidend für KMU: Es zählt immer der höhere Betrag. Die Geschäftsführung haftet zudem für die Überwachung der Compliance-Maßnahmen.

Schritt-für-Schritt: So werden Sie "AI Act Ready"

Wir empfehlen folgendes 5-Phasen-Modell für mittelständische Unternehmen:

Inventur

Listen Sie alle KI-Systeme im Unternehmen auf. Vergessen Sie nicht die "Schatten-IT" (private Accounts von Mitarbeitern für ChatGPT & Co.).

Klassifizierung

Ordnen Sie jedes System einer Risikoklasse zu. Nutzen Sie Expertenrat für Grenzfälle wie HR-Vorauswahl oder biometrische Daten.

Assessment

Führen Sie für Hochrisiko-Systeme ein Gap-Audit durch. Prüfen Sie Datenqualität, Transparenz und die Robustheit der Modelle.

Schulung

Implementieren Sie die KI-Kompetenzpflicht (Art. 4). Schulen Sie Ihr Team in der sicheren Anwendung und den rechtlichen Leitplanken.

Dokumentation

Bauen Sie eine Compliance-Akte auf. Nutzen Sie ISO 42001 Frameworks, um die Erfüllung der Rechenschaftspflicht nachzuweisen.

Pragma-Code: Ihr Partner für regulatorische Exzellenz

Die technische Umsetzung des AI Acts erfordert tiefes Verständnis für Datenarchitekturen und regulatorische Anforderungen. Pragma-Code unterstützt Sie dabei:

Compliance-Audit

Wir prüfen Ihre KI-Systeme auf Konformität mit den Artikeln 9 bis 15 des AI Acts.

Härtung

Implementierung von Logging-Systemen und Monitoring-Tools für maximale Sicherheit.

Bias-Analytics

Statistische Analyse Ihrer Trainingsdaten zur Vermeidung von Diskriminierung.

Fazit: Zertifizierte KI als Qualitätssiegel

Der EU AI Act mag wie eine bürokratische Last wirken, doch wer ihn frühzeitig umarmt, gewinnt. "Safe AI made in Europe" wird zum weltweit anerkannten Standard für Qualität und Datenschutz. KMU, die jetzt investieren, schaffen eine solide Basis für nachhaltiges Wachstum in der Ära der Künstlichen Intelligenz.

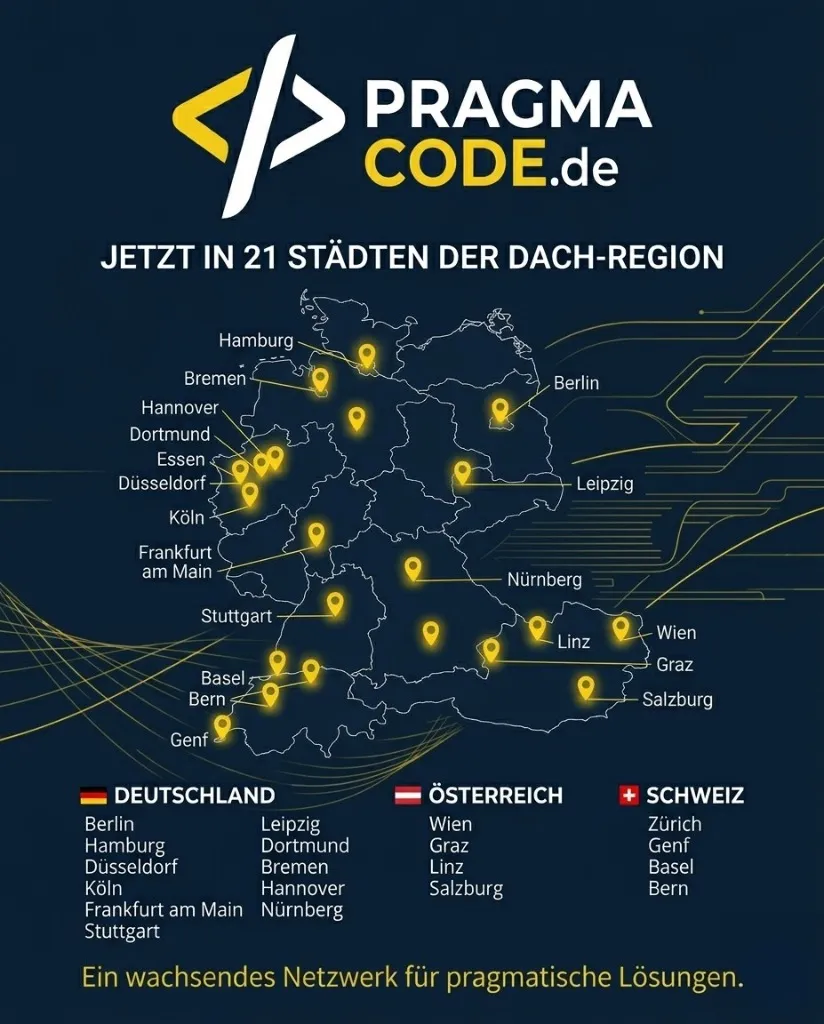

Unsere Expertise vor Ort

Wir sind Ihr digitaler Partner – regional verankert und überregional erfolgreich.

Haben Sie Fragen zur AI Act Compliance?

Pragma-Code begleitet Sie sicher durch den Dschungel der neuen KI-Verordnung. Lassen Sie uns Ihre Systeme prüfen.

Kostenlose Erstberatung vereinbarenHäufig gestellte Fragen (FAQ)

Gilt der AI Act auch für US-Software?

Ja, sobald ein KI-Dienst in der EU angeboten oder genutzt wird, muss er konform sein, unabhängig vom Sitz des Entwicklers.

Muss ich jedes kleine KI-Tool melden?

Nein, die Meldepflicht in der EU-Datenbank gilt primär für Hochrisiko-Systeme und GPAI-Modelle mit systemischen Risiken.

Was ist der Unterschied zur DSGVO?

Die DSGVO schützt personenbezogene Daten. Der AI Act schützt die Sicherheit und Grundrechte vor den Risiken algorithmischer Entscheidungen. Sie ergänzen sich gegenseitig.

Wie erkenne ich Bias in meinen Daten?

Durch statistische Prüfverfahren, die messen, ob bestimmte Gruppen (z.B. nach Alter, Geschlecht oder Herkunft) durch das System benachteiligt werden.

Gibt es Förderungen für KMU?

Ja, im Rahmen von Programmen wie "Digital Europe" stellt die EU Mittel für die Implementierung vertrauenswürdiger KI bereit.