Einleitung: Das Ende der Warteschleife

In einer zunehmend digitalen Welt ist die Erwartungshaltung von Kunden an den Service radikal gestiegen. Niemand möchte mehr in endlosen Telefonschleifen hängen oder tagelang auf die Beantwortung einer simplen E-Mail-Anfrage warten. Für kleine und mittlere Unternehmen (KMU) sowie Start-ups stellt dies eine immense Herausforderung dar: Wie lässt sich ein exzellenter, im besten Fall 24/7 verfügbarer 1st-Level-Support gewährleisten, ohne dass die Personalkosten explodieren?

Die Antwort liegt in der intelligenten Automatisierung durch KI-Chatbots und moderne Voice-Agents. Was früher großen Konzernen vorbehalten war, ist dank offener APIs (wie von OpenAI, Anthropic oder spezialisierten europäischen Anbietern) und flexibler Architekturen heute auch für den Mittelstand greifbar, skalierbar und wirtschaftlich abbildbar. Dieser Artikel beleuchtet die strategischen, technischen und wirtschaftlichen Dimensionen der Implementierung von KI im Kundenservice und zeigt auf, warum jetzt der richtige Zeitpunkt ist, um den Schritt in die automatisierte Zukunft zu gehen.

Die Evolution des Kundenservice: Vom IVR-Menü zur fließenden Konversation

Erinnern Sie sich an die Zeiten von "Drücken Sie die 1 für den Vertrieb, die 2 für..."? Diese IVR-Systeme (Interactive Voice Response) waren der erste Versuch, Anfragen zu kanalisieren. Doch sie waren starr, frustrierend und wenig kundenorientiert. Die nächste Generation waren regelbasierte Chatbots, die oft an simpelsten abweichenden Formulierungen scheiterten. "Ich habe Ihre Frage leider nicht verstanden" war die häufigste Antwort.

Heute stehen wir an einem Wendepunkt. Große Sprachmodelle (Large Language Models, LLMs) haben die Fähigkeit von Maschinen, natürliche menschliche Sprache im Kontext zu verstehen, revolutioniert. Kombiniert mit fortschrittlicher Sprachsynthese (Text-to-Speech) und Spracherkennung (Speech-to-Text) entstehen Voice-Agents, die fließende, natürliche und vor allem zielführende Dialoge führen können. Die Zeit der frustrierenden Bot-Interaktionen ist endgültig vorbei. Ein moderner KI-Agent versteht Ironie, komplex verschachtelte Sätze und kann sogar Emotionen aus der Stimme des Anrufers ableiten.

Der Paradigmenwechsel:

Moderne KI-Agenten basieren nicht mehr primär auf starren Entscheidungsbäumen (Entweder-Oder), sondern auf semantischem Verständnis und probabilistischer Textgenerierung, gepaart mit Retrieval-Augmented Generation (RAG) für faktenbasiertes Wissen.Use Cases: Wo KI-Agenten im Mittelstand glänzen

Nicht jeder Kundenkontakt sollte automatisiert werden. Der Schlüssel zum Erfolg liegt in der Identifikation der richtigen Use Cases für den 1st-Level-Support. Hier sind KI-Agenten besonders stark:

Ein KI-Voice-Agent kennt keinen Feierabend und keine Zeitzonen. Anfragen, die nachts oder am Wochenende eingehen, werden sofort in Echtzeit bearbeitet.

Während ein menschliches Team bei unerwarteten Anfragespitzen (z.B. nach einem Newsletter-Versand oder bei einer größeren Störung) überlastet ist, skaliert eine Cloud-basierte KI-Lösung mühelos mit.

Der Bot fragt Kundennummern, das genaue Anliegen und Fehlermeldungen ab, bevor er – falls nötig – perfekt vorbereitet an einen menschlichen 2nd-Level-Agenten übergibt.

Von der Terminbuchung über passwort-Resets bis hin zur simplen Adressänderung: KI-Systeme können direkt via API-Aufruf mit dem Backend (CRM/ERP) interagieren und Prozesse end-to-end abschließen.

Tieferer Einblick: Der Voice-Agent als empathischer Zuhörer

Während Text-Chatbots mittlerweile weit verbreitet sind, stellt die Integration von Voice-Agents den nächsten großen Sprung dar. Technologien wie der Advanced Voice Mode von OpenAI haben gezeigt, wie wichtig Latenz und Intonation für ein natürliches Gesprächserlebnis sind. Ein Voice-Agent kann in Echtzeit unterbrochen werden (Barge-in), reagiert auf Verzögerungen im Sprechfluss und passt seine eigene Sprechgeschwindigkeit an den Nutzer an.

Dies ist besonders für Zielgruppen relevant, die den textbasierten Chat meiden oder bei dringenden Problemen (z.B. IT-Notfall, Störung im E-Commerce-Shop) den direkten, hörbaren Kontakt bevorzugen. Die Hürde, einen Chatbot zu nutzen, wird durch die natürliche Spracheingabe drastisch gesenkt. Es entsteht eine "Zero-UI" Erfahrung – die Benutzeroberfläche ist die pure Konversation.

Technische Architektur: Wie baut man einen Enterprise-Ready KI-Agenten?

Ein intelligenter Agent besteht aus weit mehr als nur einem API-Call zu ChatGPT. Für den professionellen Einsatz im Mittelstand bedarf es einer robusten, sicheren und datenschutzkonformen Architektur. Bei Pragma Code setzen wir auf moderne Best Practices, um genau das zu gewährleisten.

Das Large Language Model (LLM) als Core-Engine

Das Herzstück ist das Modell, das die Sprachverarbeitung übernimmt. Wir orchestrieren spezialisierte Modelle (wie GPT-5.5, Claude 3.5 Sonnet oder lokal gehostete Open-Source-Modelle wie Llama 3 für maximale Datensouveränität), je nach Anwendungsfall und Datenschutzanforderung.

Retrieval-Augmented Generation (RAG)

LLMs halluzinieren, wenn sie Fakten raten müssen. RAG verbindet das Modell mit Ihrer spezifischen Unternehmensdatenbank (FAQs, Handbücher, Wiki). Der Agent "liest" erst in Ihren Dokumenten nach, bevor er antwortet. Das garantiert zuverläsisge, faktenbasierte Ausgaben.

Voice-Pipes (STT & TTS)

Für Voice-Agents benötigen wir extrem schnelle Speech-to-Text (STT, z.B. Whisper) und Text-to-Speech (TTS, z.B. ElevenLabsoder OpenAI Audio API) Komponenten. Die Gesamtlatenz (Voice-in zu Voice-out) muss zwingend unter 1000 Millisekunden liegen, um natürlich zu wirken.

Backend Integration & Tool Calling

Ein Agent, der nur redet, ist nett. Ein Agent, der handelt, ist wertvoll. Über sichere API-Endpoints (z.B. in Microservices via Node.js oder direkt angebunden an n8n) triggert der Agent Aktionen im HubSpot CRM, im Shopware-Backend oder im Jira-Ticketsystem.

Datenschutz und Compliance: Mythen vs. Realität

Viele KMUs zögern beim Einsatz von KI aus Sorge um den Datenschutz (DSGVO). Diese Bedenken sind berechtigt, aber technisch vollständig lösbar. Bei der Implementierung durch Pragma Code stellen wir sicher, dass klare Grenzen gezogen werden. Wir nutzen Enterprise-APIs, bei denen die Anbieter (z.B. Microsoft Azure, OpenAI) vertraglich garantieren, dass die übermittelten Kundendaten nicht für das Training ihrer globalen Basismodelle verwendet werden.

Für hochsensible Bereiche (Finanzen, Medizin, Legal) setzen wir auf vollständig lokal gehostete "On-Premise" LLMs. Hierbei verlässt kein einziges Datenpaket das firmeninterne Netzwerk oder das europäische Rechenzentrum. Die Kombination aus datenschutzfreundlicher Architektur und klar definierten Löschroutinen macht KI-Kundenservice heute zu 100 % DSGVO-konform machbar.

"Der wahre Wert von KI im Kundenservice liegt nicht darin, menschliche Mitarbeiter zu ersetzen, sondern sie von repetitiven Standardaufgaben zu befreien, damit sie sich komplexen, empathiefordernden Problemen widmen können."

Roadmap zur Implementierung: In 5 Schritten zum intelligenten Support

Die Einführung eines KI-Chats oder Voice-Agents sollte strukturiert erfolgen. Ein überhasteter Start ohne saubere Datenbasis führt unweigerlich zu frustrierenden Kundenerlebnissen.

-

Schritt 1: Scope & Use-Case Definition

Analyse der häufigsten Kundenanfragen (Pareto-Prinzip: Welche 20% der Fragen verursachen 80% des Aufwands?). Definition der Systeme (z.B. Zendesk, Shopify), an die der Agent andocken muss.

-

Schritt 2: Knowledge Base Vorbereitung

Aufbereitung der Unternehmensdaten für das RAG-System. Unstrukturierte Daten (PDFs, Word-Dokumente) werden bereinigt, in kleinere Chunks unterteilt und als Vektordatenbank aufbereitet.

-

Schritt 3: Prototyping & Systemprompting

Entwicklung des Kern-Agenten, Definition der Persona (Tonfall, Höflichkeit) und der "Guardrails" (was darf der Bot *auf keinen Fall* sagen oder tun?). Erste Tests in einer geschlossenen Sandbox-Umgebung.

-

Schritt 4: Integration ins Ökosystem (Tool Calling)

Anbindung an Backend-Systeme. Der Bot lernt, aktiv Tickets zu erstellen, den Lieferstatus aus dem ERP abzurufen oder Kalendertermine zu buchen. Entwicklung spezifischer Fallback-Routinen (Human-Handoff).

-

Schritt 5: Soft-Launch & Iteratives Fine-Tuning

Rollout an eine kleine Test-Benutzergruppe. Kontinuierliche Überwachung der Transkripte, Identifikation von "Edge Cases" und Feinjustierung der Prompts und der RAG-Datenbank für maximale Genauigkeit.

Der Mensch im Loop: Der Human-Handoff-Prozess

Die wichtigste Funktion eines jeden automatisierten Systems ist die Fähigkeit, seine eigenen Grenzen zu erkennen. Ein perfekt designter KI-Agent merkt, wenn der Nutzer frustriert wird, wenn das Problem zu komplex ist oder wenn sensible Themen angeschnitten werden.

In diesem Fall leitet das System einen nahtlosen "Human-Handoff" ein. Dies bedeutet, dass der Chat oder der Anruf an einen menschlichen Mitarbeiter übergeben wird. Der Clou: Der menschliche Agent erhält sofort eine vom LLM generierte Zusammenfassung der bisherigen Konversation samt identifizierter Emotion und gelösten Teilschritten. Der Kunde muss sein Problem nicht erneut erklären, und der Support-Mitarbeiter kann sofort lösungsorientiert einsteigen.

Wirtschaftlichkeit: ROI und Business Value

Die Investition in einen maßgeschneiderten KI-Agenten amortisiert sich für Unternehmen mit hohem Support-Aufkommen in der Regel innerhalb von 6 bis 12 Monaten. Die Kostenvorteile ergeben sich nicht primär aus Personaleinsparungen, sondern vielmehr aus der enormen Steigerung der Effizienz. Mitarbeiter im 1st-Level sind nicht mehr damit beschäftigt, händisch Passwörter zurückzusetzen oder Adressen zu ändern, sondern können in den 2nd-Level aufsteigen und sich um wertschöpfende Aufgaben, wie Up-Selling oder die Klärung spezifischer Reklamationen kümmern.

Kostenreduktion bei Basis-Anfragen

Die Kosten pro Interaktion (Cost per Contact) sinken von typischerweise 5-10 Euro (menschlicher Kanal) auf wenige Cent im automatisierten KI-Kanal.

Umsatzsteigerung durch Verfügbarkeit

Kunden, die am Wochenende schnelle Hilfe erhalten (z.B. im E-Commerce beim Checkout-Prozess), brechen den Kauf seltener ab.

Erhöhte Mitarbeiterzufriedenheit

Die Fluktuation in Callcentern und Support-Abteilungen sinkt, wenn monotone Arbeiten automatisiert werden und die Mitarbeiter qualifiziertere Tätigkeiten übernehmen.

Fazit: Vom reaktiven Support zum proaktiven Service-Erlebnis

KI-Chatbots und Voice-Agents sind weit mehr als nur ein technologischer Hype. Sie sind fundamentale Werkzeuge, um den 1st-Level-Support nachhaltig zu skalieren, die Servicequalität drastisch zu verbessern und Wettbewerbsvorteile im Mittelstand zu sichern.

Bei Pragma Code begleiten wir Sie von der ersten Use-Case-Findung bis zur Implementierung robuster, sicherer und DSGVO-konformer Agenten. Wir bauen keine "Stangenware", sondern integrieren die KI tief in Ihre bestehenden Systeme, um echten Business Value zu generieren. Die Zukunft des Kundenservice spricht mit Ihnen, versteht Sie und handelt für Sie. Seien Sie bereit dafür.

Unsere Expertise vor Ort

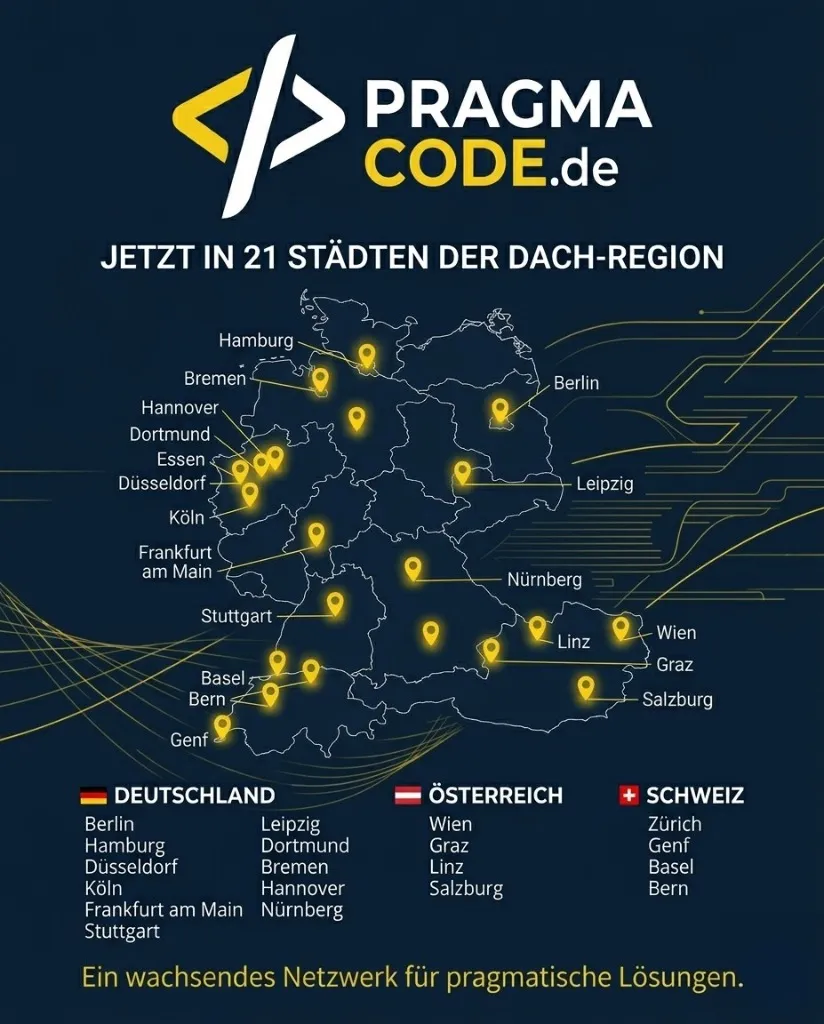

Wir sind Ihr digitaler Partner – regional verankert und überregional erfolgreich.

Haben Sie eine Vision?

Lassen Sie uns gemeinsam prüfen, wie wir Ihre Ideen für einen automatisierten Support zum Fliegen bringen.

Jetzt kostenloses Strategiegespräch buchenErweitertes Fachglossar

LLM (Large Language Model)

Ein KI-Modell, das auf riesigen Textmengen trainiert wurde, um kontextbezogene, menschenähnliche Antworten zu generieren.

RAG (Retrieval-Augmented Generation)

Eine Technik, bei der das LLM mit externen, spezifischen Wissensdatenbanken angereichert wird, um halluzinationsfreie, präzise Aussagen zu treffen.

Voice-Agent

Ein KI-System, das gesprochene Sprache in Echtzeit analysiert (Speech-to-Text), eine Antwort generiert und sie mit einer natürlichen Stimme ausspricht.

Barge-in

Die Fähigkeit eines automatisierten Sprachsystems, zu erkennen, wenn der menschliche Sprecher es unterbricht, daraufhin sofort zu pausieren und zuzuhören.

Human-Handoff

Der nahtlose Übergabeprozess von einem Bot zu einem echten menschlichen Support-Mitarbeiter im laufenden Gespräch.